Il settore della gestione del traffico aereo rappresenta una delle infrastrutture più critiche e complesse del panorama moderno, dove la precisione e l’affidabilità non sono semplici obiettivi operativi, ma requisiti di sicurezza assoluti. In occasione dell’evento “Artificial Intelligence: adozione, trasformazione, equilibrio”, organizzato dall’Osservatorio Artificial Intelligence del Politecnico di Milano, Giuseppe Labanca, Head of Innovation di ENAV, ha delineato il percorso che l’ente sta seguendo per l’integrazione delle nuove tecnologie. Il punto di partenza di questa evoluzione è il quadro normativo europeo definito dall’AI Act, un regolamento che richiede una declinazione estremamente specifica per poter essere applicato con successo in un ambito ad alto rischio come quello aeronautico.

innovazione nella mobilità

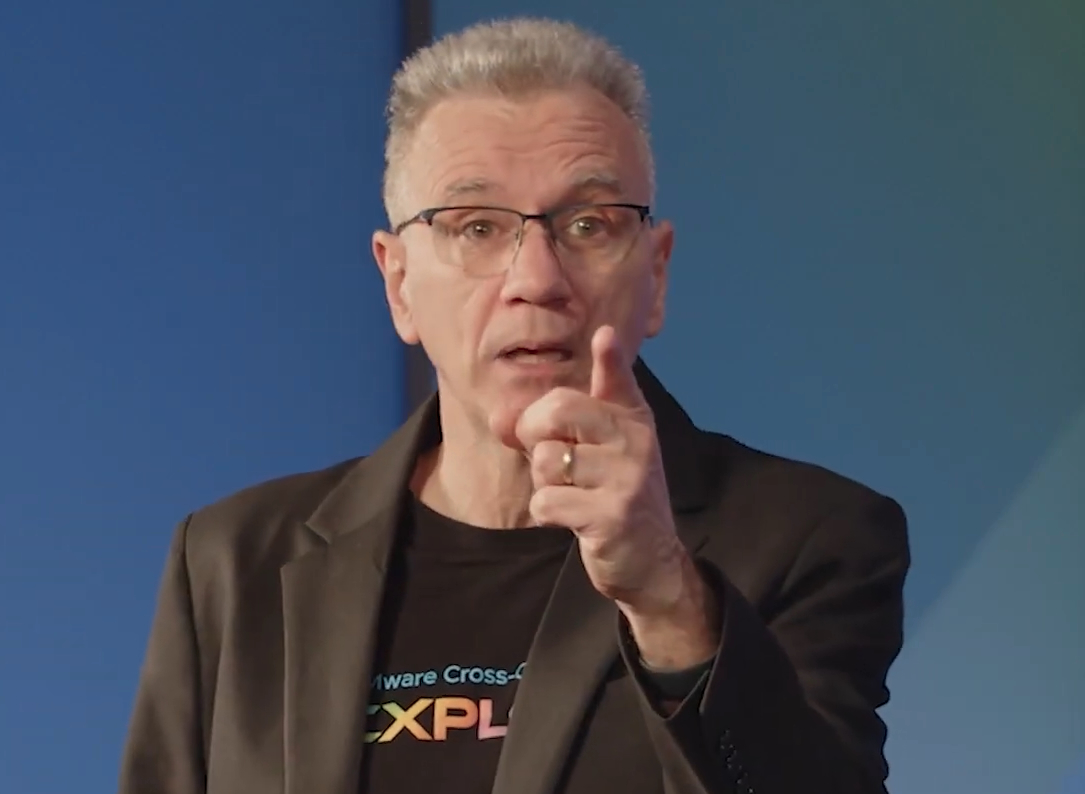

Giuseppe Labanca, Head of Innovation di ENAV: “Così implementiamo l’AI Act nei cieli europei per la sicurezza aerea”

Il responsabile dell’Innovazione in Enav illustra la strategia per integrare l’AI nel traffico aereo. Si punta sulla traduzione tecnica dell’AI Act e sulla collaborazione internazionale. Obiettivo: massima sicurezza nei sistemi di controllo

Continua a leggere questo articolo

Aziende

Argomenti

Canali

INNOVATION LEADER

-

Sabrina Maniscalco, la fisica dei contrasti e la sua scommessa sul quantum computing italiano

13 Mag 2026 -

Piergiorgio Grossi: “Bisogna diventare esperti nell’imparare a imparare”

12 Mag 2026 -

Edison, Dotti e Montelatici: “Dall’AI alla GenAI, ora abbiamo superpoteri per gestire impianti e processi”

07 Mag 2026 -

Generali Investments nomina il suo primo Chief Artificial Intelligence Officer (CAIO): chi è e cosa farà

28 Apr 2026 -

Giulio Bonazzi, CEO Aquafil: “Le sfide della chimica fra innovazione ed economia circolare”

22 Apr 2026